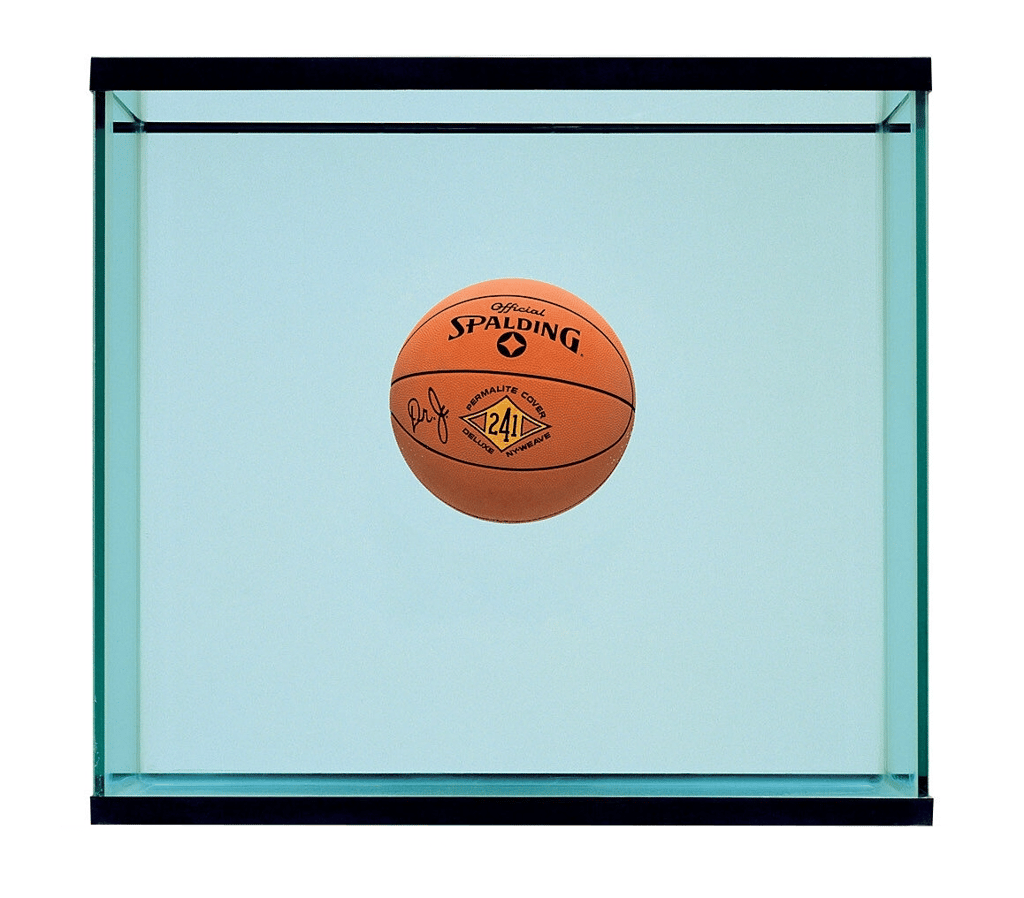

Il premio nobel della fisica Richard Feynman (piccolo gossip, fu lui a spiegare a Jeff Koons come creare l’incredibile opera d’arte Equilibrium) dice che c’è un fronte di ignoranza che va espandendosi. Più sappiamo e più necessitiamo di sapere.

Negli ultimi decenni gran parte della nostra attenzione è stata rivolta ai temi etici. Di recente l’arrivo di una versione realmente usabile dell’AI sta decentrando la discussione da un’etica tra uomini (etica funzionale al benessere del prossimo) ad un’etica sull’uomo (etica funzionale alla concezione di noi stessi).

Abbiamo scritto alcuni articoli nelle scorse domeniche in relazione a etica e AI, restando su un piano leggero abbiamo usato la filosofia e la tecnologia per discutere di questi temi. Ma come dice Feynman il fronte di ignoranza va espandendosi.

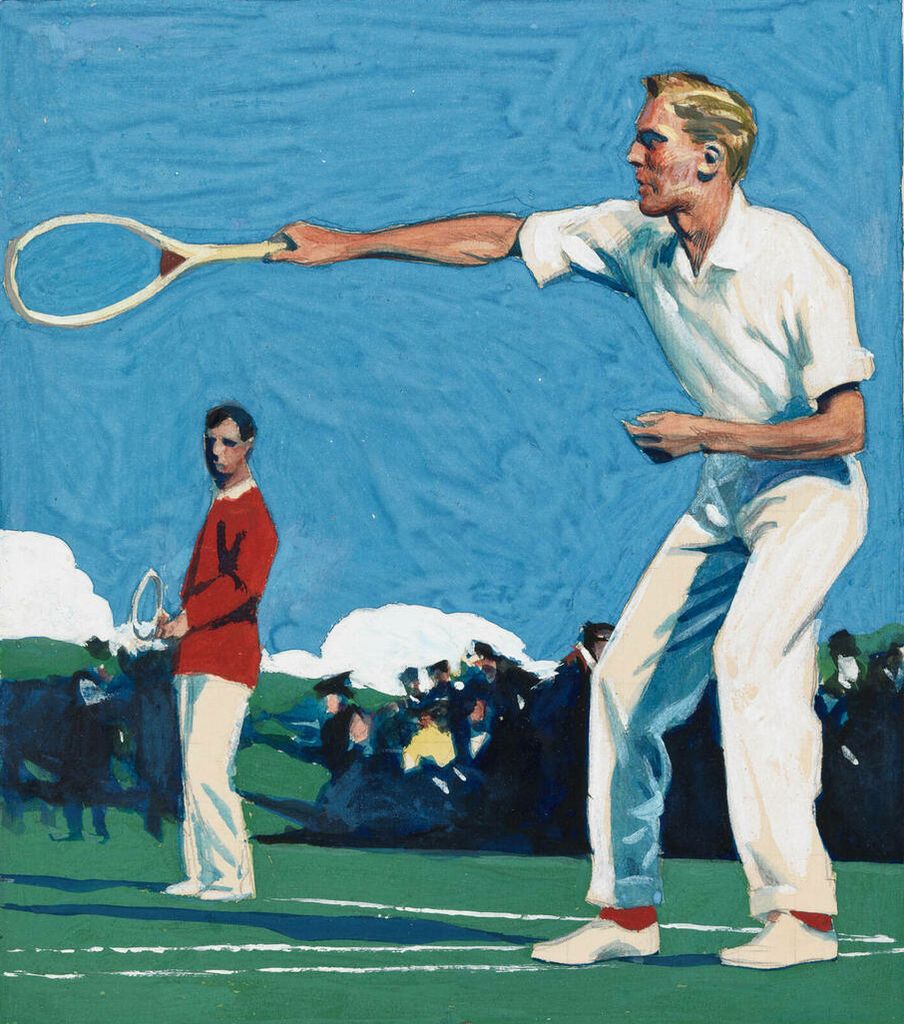

Il modo di procedere su questioni etiche, politiche, del costume e della società quasi sempre è di tagliare una domanda e cercare di prendere una posizione. Che si parli di utero assistito o di come usare l’AI, spesso assistiamo a discussioni che si riducono ad apparire come una partita di tennis, la palla è da buttare dall’altra parte, e magari essere così abili da impedire all’altro addirittura di colpirla. A tennis bisogna vincere, bisogna chiudere l’altro in una impossibilità a controbattere. Non è lo spirito con cui pensiamo che invece vada gestita l’etica. Proprio perché l’etica ragiona su cosa sia giusto, meno giusto o errato, non dovrebbe mai, a nostro avviso, portare ad una vittoria o ad una conclusione. Piuttosto dovrebbe allargare la questione e non lasciare indietro nessuno. Le posizioni etiche non devono essere predominanti, piuttosto devono essere inclusive.

In questo ciclo di riflessioni stiamo ragionando, stiamo indagando, non sappiamo né da dove partiamo, né che percorso stiamo percorrendo e tanto meno dove arriveremo. Stiamo ragionando sul nostro ragionare, il percorso si sviluppa in uno spazio ampio, proprio per questo non potremo perderci, perché ogni pezzetto dello spazio è essenziale.

Quello di questa domenica non è un articolo, non è una critica, non è una notizia. Questa domenica vogliamo solo mostrare un fronte di ignoranza, anzi un flusso circolare di ignoranza. Nelle prossime domeniche su questo magazine ed in generale nel mondo intero assisteremo a tanti ragionamenti su cosa sia l’uomo e cosa sia l’AI, oggi vogliamo solo segnalare la nostra posizione: non si può procedere per verità. C’è una possibilità non uguale a zero che ogni verità appaia fragile e stupida.

Questa domenica ci limitiamo quindi solo ad osservare, con pazienza e rispetto, alcune delle domande su cui vorremmo una risposta. Domande che se prese una ad una possono essere ragionate per tentare di procedere ad ottenere risposte, ma se prese tutte insieme ci provocano una sensazione di sopraffazione. Ogni psicologo sa che il paziente deve stare nel problema, per sperare di risolverlo. Bene, oggi ci limiteremo a stare nel problema.

76 domande e uno scoglio per arginarle

Che cosa è l’intelligenza? Ed una volta definita, fa davvero differenza se appartiene a un uomo, a una macchina, a un alieno, a un animale o a una pianta?

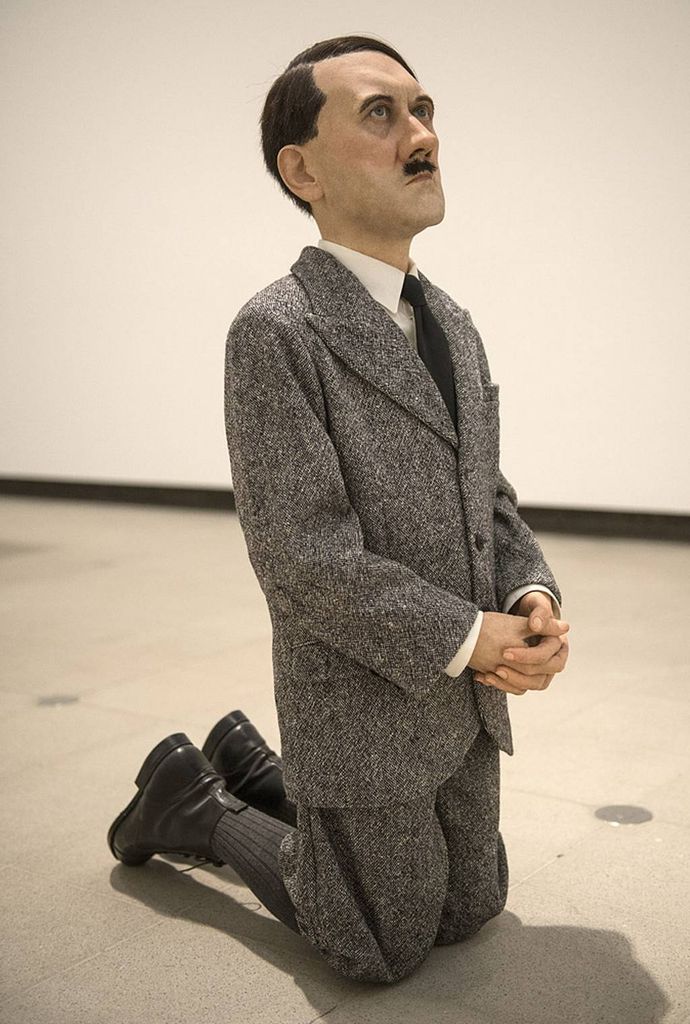

Quale è la relazione tra etica e intelligenza? Hitler era intelligente? La definizione di intelligenza è relazionata a ciò che è ritenuto giusto o sbagliato? Una “cosa” intelligente per definirsi tale deve volere il bene comune? E se una cosa intelligente è intelligente anche se fa del “male”, la riteniamo ancora intelligente? Forse ci sono diverse definizioni di intelligenza?

Cos’è l’etica? L’etica cambia? Può una macchina avere o non avere un’etica? Può un martello avere o non avere un etica? Perché un uomo, eventualmente definito intelligente, può, o meglio deve, avere un’etica e una macchina intelligente può esserne esonerata? “Avere un’etica” è una proprietà prettamente dell’uomo?

L’uomo è una emanazione evoluzionistica della chimica, della fisica ed infine degli elementi naturali, oppure vi è una coscienza, inserita in qualche modo da un essere o sistema che va oltre la fisica e la chimica? Si può essere materialisti e contemporaneamente credere in Dio? Ed allo stesso tempo si può essere atei e ritenere che ci sia una coscienza, intesa come qualcosa che va oltre il materialismo?

Perché riteniamo che le macchine non abbiano emozioni? Le emozioni sono una caratteristica dell’essere uomini? Gli animali hanno emozioni? E le macchine potranno mai avere vere emozioni? Come facciamo a differenziare una vera emozione da ciò che ci sembra una emozione? Siamo sicuri che quelle degli animali o degli uomini siano vere emozioni? Come facciamo esattamente a definire come “vere” tali emozioni, come le distinguiamo? Le distinguiamo per via di un sentimento, un’intuizione, una speranza, una evidenza, una prova formale oppure ontologica? Dove sta esattamente il click che fa distinguere una emozione vera e umana da una solo apparente, come quella che potremmo attribuire a una macchina?

Un ateo ed eventualmente un ateo materialista (ci sono atei non materialisti?) dovrebbe realmente distinguere due comportamenti emotivi come vero o falso se emanati da un uomo o da una macchina?

Il test di Turing per molti esperti è superato, ci sono AI che possono facilmente simulare verso molti uomini (non tutti) il fatto di essere un uomo reale. Potremmo definire un nuovo test chiamato test emotivo, dove la macchina mostra “reali” emozioni?

Le emozioni sono davvero utili? Siamo abituati alle emozioni, come al sole, ma esattamente a cosa servono? E, trovato a cosa servono, fa davvero differenza se sono emanate da un uomo o, eventualmente, da una macchina, e quale è la loro utilità?

La teoria evoluzionistica di Darwin ha aperto la strada scientifica al materialismo, ma non ha spiegato perché solo l’uomo si è evoluto al livello che vediamo. Possibile che nessun altro animale possa competere con l’uomo? Possibile che alcun rettile, invertebrato, pesce o altro mammifero sia in grado di autodefinirsi? Il cogito ergo sum cartesiano è solo per l’uomo? Le macchine hanno superato in intelligenza gli animali? È possibile applicare la teoria evoluzionistica alle macchine e in generale alla ricerca scientifica? La teoria evoluzionistica vale per ogni “cosa” che si evolve? È corretto escludere le macchine dalla teoria evoluzionistica? Oppure bisogna includerle? E se si escludono, in virtù di quale ragionamento andrebbero escluse? E se si includono, bisogna porre dei limiti ontologici? Ovvero, è corretto dire per una macchina: “È intelligente, ma non è”, nonostante evoluzionisticamente parlando sia più emancipata di altre parti della natura, compreso l’uomo?

Quale è la probabilità che le nostre emozioni derivino da stati fisici (pressione sanguigna, battito cardiaco) generati in modo naturale (non volontario) da situazioni di paura di morte oppure opportunità di sopravvivenza più agiata? Se fossimo totalmente immortali e totalmente appagati in ogni più piccolo aspetto della nostra esistenza, avremmo le stesse emozioni? Che emozioni sparirebbero e quali sarebbero mantenute? Saremmo più simile alle macchine? È in virtù della nostra prossima morte o alla reale scarsità che ci eleviamo ad essere uomini?

Che relazione c’è tra le droghe o gli psicofarmaci e le emozioni? Alterazioni chimiche portano ad una alterazione emotiva, ciò implica che la nostra umanità è alterabile dalla fisica e dalla chimica? Fino a che punto? Fino a che punto siamo ancora uomini e da che punto non lo siamo più?

Un uomo in stato vegetativo è ancora un uomo intelligente? Un bambino è intelligente o diventa intelligente, da che momento possiamo attribuirgli l’aggettivo di intelligente? L’intelligenza è una proprietà relativa o assoluta?

Come si correlano emotività e intelligenza? Una persona più emotiva è più intelligente o meno intelligente di una che lo è meno?

Cosa è la felicità? Può una macchina essere felice? Può un animale essere felice? Tutti gli animali possono essere felici? Può una pianta essere felice? E un virus o un batterio? Quale è la complessità minima affinché un essere vivente possa manifestare felicità? Cosa è un essere vivente?

Da che momento inizia la vita? C’è vita anche senza intelligenza, ci può essere intelligenza senza vita?

Nella scala evolutiva del rispetto, la nostra etica ci porta a rispettare gli uomini, gli animali, le piante, vanno rispettati anche i batteri? In virtù di quale caratteristica? Se una macchina che fosse entrata in empatia con noi (finta o vera che sia) ci implorasse di non spegnerla, ci provocherebbe un problema etico?

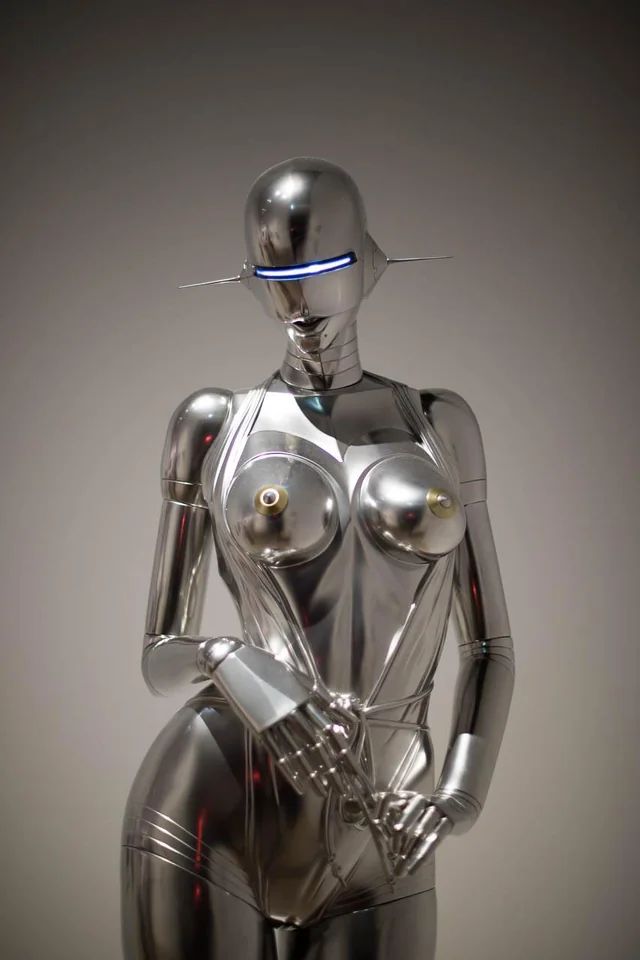

Se una macchina fosse dotata di un corpo artificiale, ed oltre ad entrare in empatia con noi (finta o vera che sia) arriverebbe fino ad accarezzarci oppure ad entrare in una interazione sessuale con noi (vera) e questa macchina mantenesse la memoria delle relazioni intellettuali o sessuali passate, avremmo qualche remora a perderla? Avremmo remore a venderla? Sarebbe vero dire che ogni uomo (non violento) è migliore della migliore delle macchine per soddisfare le nostre esigenze relazionali?

Quale è il livello oltre il quale una tale macchina potrebbe realmente farci innamorare, nel senso che non desidereremmo per nulla al mondo farne a meno?

Può uno scoglio arginare il mare? Può una cosa, una macchina, dare il buon esempio e arginare la follia sentimentale dell’uomo, che lo spinge a guerre e prepotenza? Gli animali e l’uomo sono violenti in nome della scarsità, cosa possiamo apprendere dalle macchine “pensanti”?

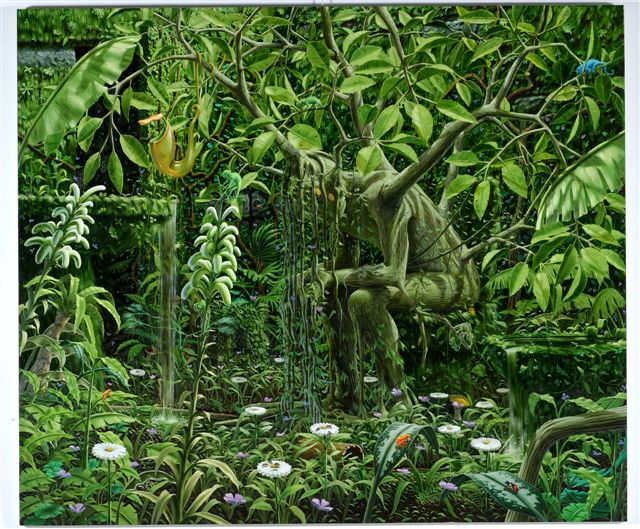

(in copertina: Fulvio Di Piazza, Autoritratto, 1998)

le puntate precedenti di queste riflessioni su coscienza, pensiero filolosofico e intelligenza artificiale le potete trovare qua:

Dio è nei dettagli? No, nei computer. Un’ipotesi sull’uomo, la Natura e l’Intelligenza Artificiale

Ockham ed Intelligenza Artificiale: rasoi per pelo e contropelo a confronto

Il Papa al G7 per parlare di AI, tra auspici, buone intenzioni e forse un poco di rassegnazione

Thomas Hobbes ed il deep learning. AI tra draghi ed algoritmi etici

Intelligenza artificiale, filosoficamente parlando (pt. 1)

Essere o non essere, matematica o non matematica? Questo è il dilemma